OpenAI 推出新的資料控制選項來改善 ChatGPT 的隱私

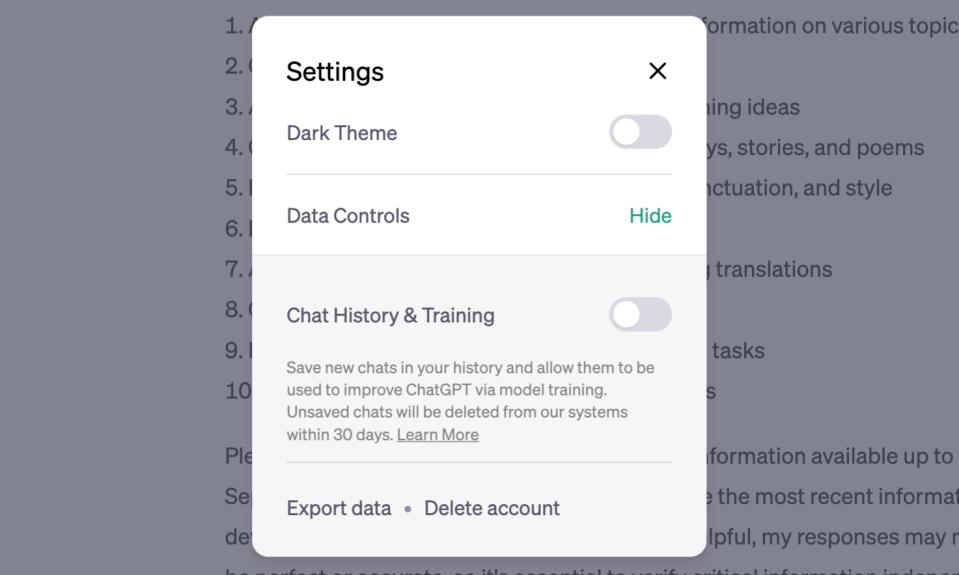

OpenAI 終於開始解決目前最為人詬病的資料安全性問題了。ChatGPT 的用戶現在可以選擇關閉聊天歷史,避免自己輸入的資料被用來訓練 ChatGPT 的 AI 模型。相關設定可以在「設定(Settings)」當中的「資料控制(Data Controls)」中找到,包括一個「聊天歷史與訓練」的開關,以及輸出資料和刪除帳號的選項。

不過就算關掉了歷史與訓練,OpenAI 依然會儲存你的輸入內容 30 天的時間。OpenAI 表示這是為了避免濫用,並且只有在有監管需求時,才會查看這些輸入記錄。過了 30 天之後,你輸入的內容將會被永久移除。至於輸出資料的選項,除了讓你可以保留一份紀錄之外,也可以讓用戶更清楚了解 ChatGPT 究竟是收集了什麼資料。

除了多這個控制之外,OpenAI 還將在現有的 ChatGPT Plus 之外,新增一個「ChatGPT Business」的訂閱層級。這個層級是以「需要更精確控制資料的專業人士」及「想更好地管理員工使用的企業」為對象,預設就是不會使用資料來進行訓練的。這個新訂閱層級將在「未來數個月」正式上線。

本月稍早,三名 Samsung 員工因為將敏感資訊「洩露」給了 ChatGPT 而上了新聞,也突顯了使用聊天機器人時的資料控管問題,特別是企業機密。此次 ChatGPT 的改動,也可以視為是對類似情況的回應吧。

Yahoo奇摩財經

Yahoo奇摩財經